الذكاء الاصطناعي يمد يده إلى الانتخابات حول العالم.. دق ناقوس الخطر؟

|

استمع إلى المقال

|

استخدامات الذكاء الاصطناعي توسعت إلى الكثير من المجالات المختلفة، وأصبحت تطبيقاته الآن قادرة على توليد مواد دعائية تستخدم في مختلف الحالات بسهولة ويسر وبشكل يقترب كثيرا من ذاك الذي تنتجه الأيدي البشرية لدرجة تهدد العمالة البشرية في مختلف القطاعات.

دعاية الانتخابات والمواد الانتخابية المختلفة هي إحدى القطاعات التي توسع إليها الذكاء الاصطناعي مؤخرا بشكل غير متوقع، ورغم أن الذكاء الاصطناعي يستمر في التطور والاقتراب أكثر من الأداء البشري، إلا أن السؤال الحقيقي هنا لا يجب أن يكون عن جودة المواد الدعائية التي ينتجها الذكاء الاصطناعي، ولكن حول مدى أخلاقية استخدام هذه المواد في التأثير على القرار الانتخابي الذي يتخذه البعض وإن كانت تندرج تحت بند الدعاية المضللة أم لا.

في تورنتو، المدينة الكندية الهادئة التي كانت مهدًا للكثير من الشركات التقنية المهتمة بالذكاء الاصطناعي واستخداماته المختلفة، بدأت موجة استخدام الذكاء الاصطناعي في توليد المواد الانتخابية الدعائية، وتحديدا ضمن حملة أنتوني فوري الذي كان صحفيا سابقا وقرر الآن المشاركة في السباق الانتخابي على مقعد عمدة المدينة.

حملة فوري قررت استخدام مستند كبير يضم عشرات الصفحات التي توضح إيمان فوري بأهمية مواجهة الجريمة ومحاولة القضاء عليها قدر الإمكان، ولكن المشكلة أن هذا المستند صُنع عبر أدوات الذكاء الاصطناعي بشكل كامل ودون أي تدخل بشري، وهذا بالطبع تسبب في أزمة دعائية لاحقت الحملة، إذ ضم المستند مجموعة كبيرة من الصور المزيفة التي تظهر بوضوح أخطاء الذكاء الاصطناعي في توليد الصور، مثل ظهور أشخاص مع ثلاثة أذرع أو أشخاص لا يبدون كالبشر.

المستند الذي شاركته حملة فوري عبر موقعها الرسمي ليس المادة الوحيدة التي أنتجها الذكاء الاصطناعي، إذ شاركت أيضا مجموعة من الصور المختلفة التي توضح أهداف الحملة، وهي جميعا صور أنتجها الذكاء الاصطناعي دون تدخل بشري.

رد الفعل الذي حازت عليه هذه الصور في الأغلب كان السخرية والتهكم من أعضاء السباق الانتخابي الآخرين، ولكنها أيضا قدمت له دفعة كبيرة جعلت اسمه يبرز بين 100 مرشح انتخابي، وهو الأمر الذي دفع فوري للاعتراف باستخدامه أدوات الذكاء الاصطناعي ونيته في إعادة استخدامها مستقبلا حتى يتقنها وتنتج صورا حقيقية بالكامل.

حملة فوري لم تكن الوحيدة التي اتجهت لاستخدام الذكاء الاصطناعي، إذ شارك أحد الأحزاب السياسية في نيوزيلندا صورة عبر حساب “إنستغرام” الرسمي لهم لمجموعة من المجرمين يتهجمون على متجر للمجوهرات، وبالطبع كانت هذه الصورة مولدة عبر الذكاء الاصطناعي بالكامل.

ما بدأ كمجموعة من رسائل البريد الإلكتروني والتصريحات المنقّحة، تحول الآن إلى حملات دعائية كاملة يدفعها الذكاء الاصطناعي دون أي تدخل بشري في المنتج النهائي، فقط عند إدخال الأوامر الأولى من أجل توليد هذه المواد.

سام ألتمان، الشخص الذي يقف خلف الانفجار الأخير في موجة الذكاء الاصطناعي بفضل “ChatGPT” تحدث بكل وضوح في إحدى جلسات مجلس “الشيوخ الأميركي” حول هذا الأمر تحديدا، وقال بأنه يخشى ما قد يحدث في موسم الإنتخابات، وذلك بسبب قدرة الذكاء الاصطناعي على توليد محتوى قادر على خداع البشر وتزويدهم بمعلومات خاطئة.

الخبراء السياسيون يشاركون ألتمان في مخاوفه، وذلك ظهر بوضوح في تصريحات لاري هوينه رئيس الجمعية الأميركية للمستشارين السياسيين الذي قال،

“سيميل الناس إلى تجربة التقنية ومحاولة اختبارها ومعرفة حدودها، ومثل أي أداة، فإنه ستكون هناك بعض الاستخدامات السيئة التي ستحاول الكذب على الناخبين وتضليلهم عبر دفعهم للإيمان بشيء غير موجود”.

الجمعية الأميركية للمستشارين السياسيين أدانت استخدام أدوات الذكاء الاصطناعي من أجل بناء حملات الدعاية الانتخابية المضللة، ووصفتها بخرق للمعايير الأخلاقية للحملات الانتخابية المختلفة.

بناء المواد الدعائية الكاذبة أو الوهمية ليس الخطر الأكبر الذي تفرضه أدوات الذكاء الاصطناعي المتقدمة، ولكن هذه المخاطر تزداد وترتفع عند دخول تقنيات “Deepfake” التي يمكنها أن تزور مقاطع فيديو كاملة أو حتى محادثات صوتية بأكملها قادرة على التأثير في القرار الانتخابي النهائية.

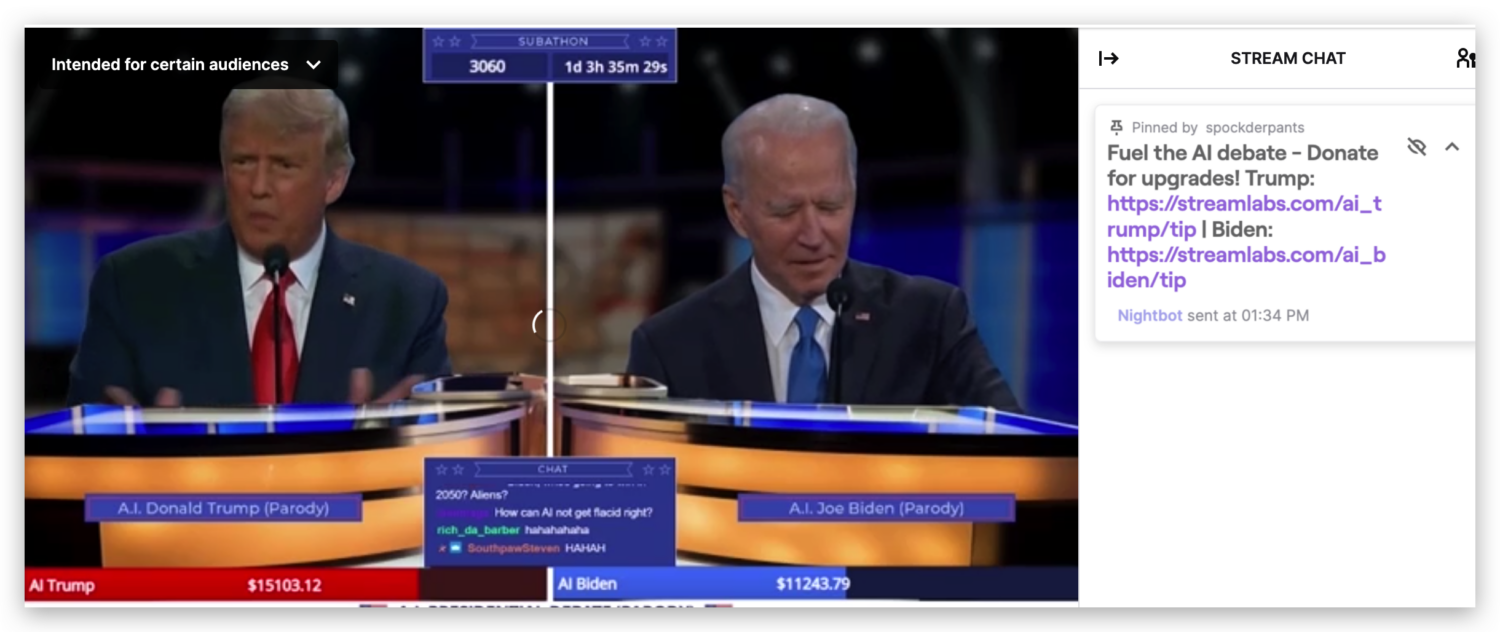

منذ عدة أيام، ظهر بث حي في منصة “تويتش” يضم الرئيس الأميركي الحالي جو بايدن ودونالد ترامب الرئيس السابق وهما يتناقشان في عدة قضايا هامة، للوهلة الأولى قد يبدو الأمر طبيعيا ومنطقيا، ولكن ما يثير الذعر هو أن هذا اللقاء بأكمله كان مولدا عبر الذكاء الاصطناعي، وهذا يعني أن نص الحديث والأصوات ومقاطع الفيديو جميعها كاذبة وغير حقيقية.

البث الحي المذكور أعلاه وضح في أكثر من مكان أنه مولد عبر الذكاء الاصطناعي وليس حقيقيا، وذلك في نص البث وفي المقطع نفسه وعبر العلامات المائية، ولكن قد يتجاهل البعض هذا الأمر، خاصة وأن لعبة الانتخابات والسياسة ليست نزيهة دائما وقد يوجد بعض المرشحين المستعدين للقيام بأي شيء.

بين كولمان، وهو الرئيس التنفيذي لشركة “Reality Defender” إحدى الشركات المتخصصة في كشف مقاطع الذكاء الاصطناعي المزورة صرح في حواره مع صحيفة “نيويورك تايمز” قائلاً، “محاولة إقناع الملايين بأن ما رأوه بأعينهم هو مجرد محتوى مزور ليس كافيا وهو متأخر للغاية”، ويتفق معه جوش غولدشتاين الباحث الأمني في جامعة “جورج تاون”، إذ قال، “إذا فقد الناس القدرة على الثقة فيما رأوه بأعينهم، فإنهم يفقدون القدرة على تصديق أي شيء آخر وسيكون ردهم دائما، من يعلم؟!”

هناك استخدام آخر مخيف لهذه التقنيات، وهو محاولة بناء وتصنيع نصوص خطابية مخصصة لتوليد ردود فعل بعينها، وذلك مثلما حدث مع كارثة “كامبردج أناليتكا”، إذ يمكن عبر تزويد روبوتات الدردشة الذكية مثل “ChatGPT” بمعلومات عن الناخبين، ثم تطلب منه أن يتقمص دور هذا الناخب في محاولة لاستكشاف ردوده وما يراه حول الجوانب المختلفة أو حتى استطلاع رأيه عن المواد الانتخابية المختلفة.

المشكلة الأكبر تكمن في أن استخدام تقنيات الذكاء الاصطناعي ليس مقصورا على الجهات الداخلية فقط، بل يمكن أن تقوم أي جهة خارجية في دعم مرشح ما أو محاولة نشر معلومات مغلوطة مصنوعة بالكامل من الذكاء الاصطناعي مما يؤثر في القرار الانتخابي لجموع الناخبين.

منع الدعاية الانتخابية الكاذبة وبناء المواد الدعائية الكاذبة مهمة ليست سهلة، ولا يمكن الاعتماد على القوانين الحكومية فقط لإتمامها، وذلك لأن هذه القوانين سوف تكون قاصرة وغير قادرة على تخيّل مستوى التطور الذي وصلت إليه تقنيات الذكاء الاصطناعي، كما أن الشركات بمفردها غير قادرة على القيام بذلك.

الحل الأمثل -رغم أنه ليس سهلا- هو بناء تعاون وثيق بين الحكومات والشركات العاملة في مجال الذكاء الاصطناعي، وذلك من أجل خلق هيئة أو منظمة تكون مسؤولة عن اكتشاف هذه المقاطع المزورة وتطبيق عقوبات رادعة تمنع تكرار التزوير أو حتى محاولة نشره بين جموع الناخبين.

هل أعجبك المحتوى وتريد المزيد منه يصل إلى صندوق بريدك الإلكتروني بشكلٍ دوري؟

انضم إلى قائمة من يقدّرون محتوى إكسڤار واشترك بنشرتنا البريدية.