بعد تجربة Humane ai دبوس الذكاء الاصطناعي الاول.. آراء مخيبة للامال

بعد تجربة Humane ai دبوس الذكاء الاصطناعي الاول.. آراء مخيبة للامال

بعد تجربة Humane ai دبوس الذكاء الاصطناعي الاول.. آراء مخيبة للامال

بعد تجربة Humane ai دبوس الذكاء الاصطناعي الاول.. آراء مخيبة للامال

تشارجر دايتونا ولكن كهربائية صديقة للبيئة!

تشارجر دايتونا ولكن كهربائية صديقة للبيئة!

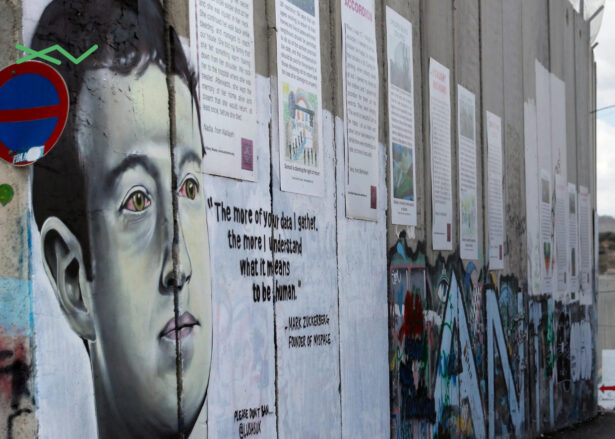

هجمات محددة.. برامج التجسس تُركز على مستخدمي آيفون في جنوب آسيا

هجمات محددة.. برامج التجسس تُركز على مستخدمي آيفون في جنوب آسيا

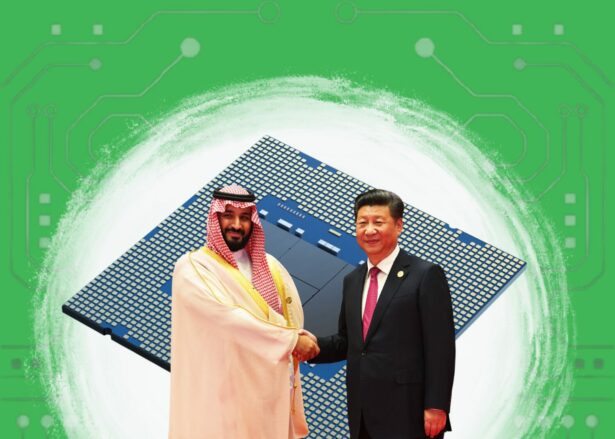

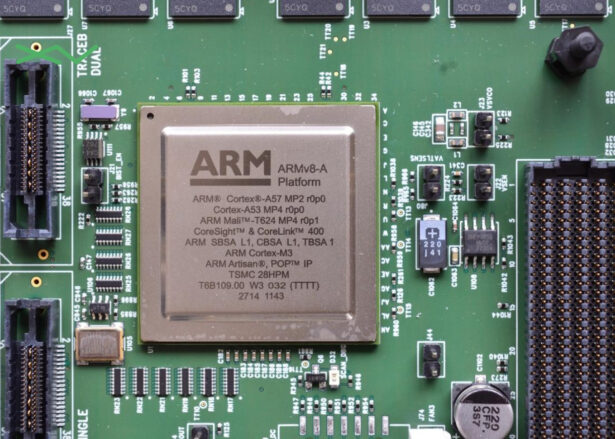

شرائح 2 نانومتر القادمة من “سامسونج” ستكون أميركية الصنع

شرائح 2 نانومتر القادمة من “سامسونج” ستكون أميركية الصنع

أفضل أدوات الذكاء الاصطناعي لمساعدتك على تدوين الملاحظات بطريقة مبتكرة

أفضل أدوات الذكاء الاصطناعي لمساعدتك على تدوين الملاحظات بطريقة مبتكرة

ثغرات “إل جي” .. خطر التجسس على منازلنا

ثغرات “إل جي” .. خطر التجسس على منازلنا

برامج التجسس تُهدد مستخدمي “أبل”.. صراع مستمر مع ثغرات يوم الصفر

برامج التجسس تُهدد مستخدمي “أبل”.. صراع مستمر مع ثغرات يوم الصفر

“أبل” تفكر الدخول في قطاع الروبوتات الذكية

“أبل” تفكر الدخول في قطاع الروبوتات الذكية