آخرها الحرب في أوكرانيا: تاريخٌ من استخدامات تقنية التعرف على الوجه لأسباب أمنية

|

استمع إلى المقال

|

مما لا شك فيه أن هناك اهتمامًا كبيرًا في الولايات المتحدة بعمق وإمكانات أنواع مختلفة من تكنولوجيا الذكاء الصنعي للاستخدام الدفاعي والعسكري، وهي خطوة مهمة في الاتجاه الصحيح للحاق بالسباق التكنولوجي مع الصين.

قال نائب رئيس أركان المخابرات والمراقبة والاستطلاع في سلاح الجو الأمريكي، الفريق فيرالين جاميسون، إن الصين أنفقت بالفعل 12 مليار دولار على البحث والتطوير في مجال الذكاء الصنعي في عام 2017 و 70 مليار دولار في عام 2020.

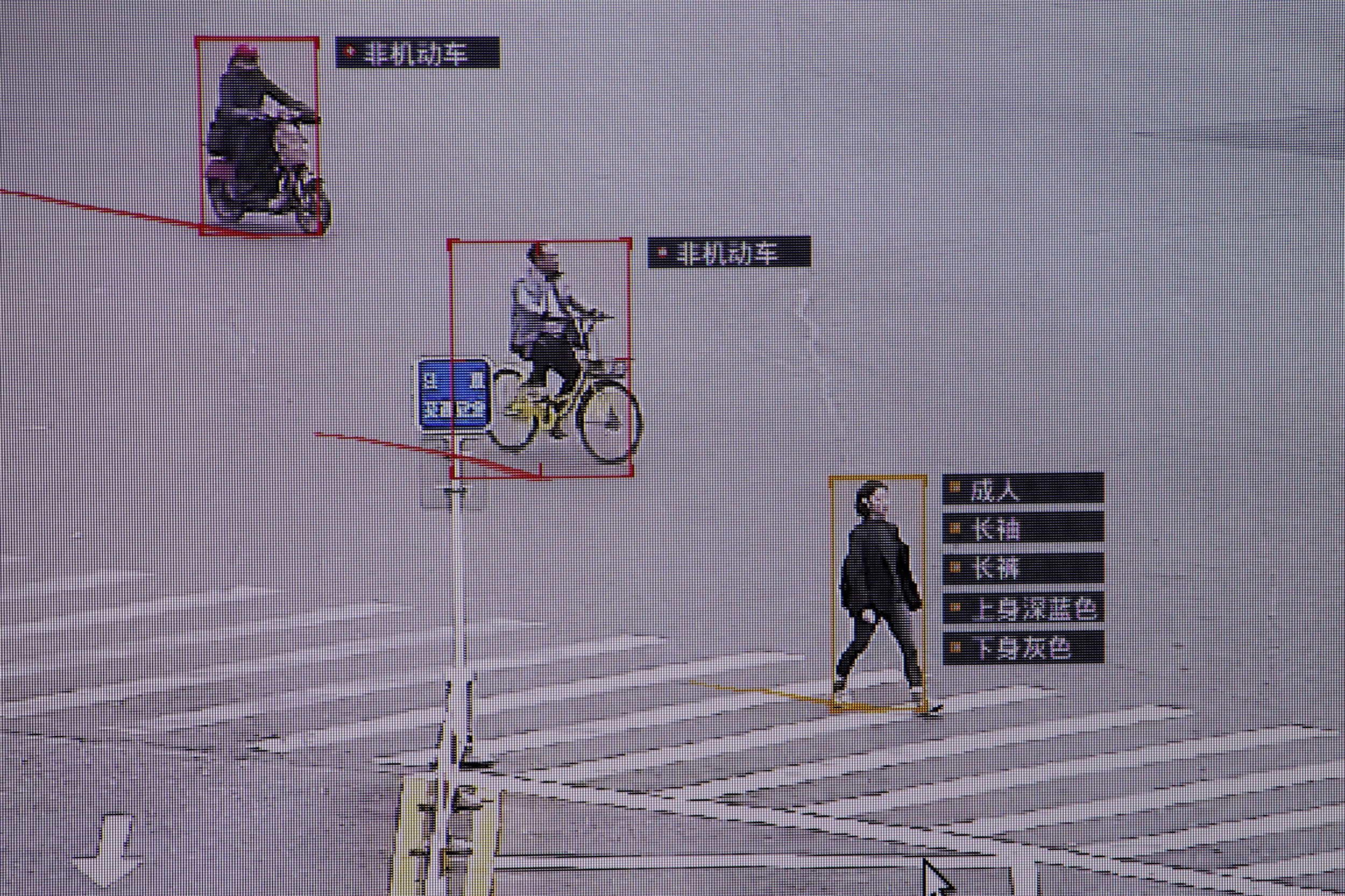

المستفيدون الرئيسيون من هذا الاستثمار من قبل الحكومة الصينية هم شركات الذكاء الصنعي الناشئة، وهذا يتجلى في مجال التعرف على الوجه. فالكاميرات منتشرة في أرجاء الصين، ويقبل المواطنون المراقبة المستمرة تقريبًا. نتيجة لذلك، انطلق تطوير خوارزميات التعرف على الوجه القائمة على الذكاء الصنعي.

يقوم نظام التعرف على الوجه في الصين على تسجيل كل مواطن تقريبًا في البلاد، مع شبكة واسعة من الكاميرات في جميع أنحاء البلاد. أعطى تسريب قاعدة البيانات في عام 2019 لمحة عن مدى انتشار أدوات المراقبة في الصين مع أكثر من 6.8 مليون سجل في اليوم الواحد، مأخوذة من الكاميرات الموضوعة حول الفنادق والمتنزهات والمواقع السياحية والمساجد، وحتى تفاصيل تسجيل الأشخاص الذين لا تتجاوز أعمارهم 9 سنوات.

الحكومة الصينية متهمة باستخدام التعرف على الوجه لارتكاب فظائع ضد مسلمي الأويغور، بالاعتماد على التكنولوجيا لتنفيذ “أكبر سجن جماعي لأقلية من السكان في العالم اليوم”.

قالت مجموعة من 17 عضوًا في مجلس الشيوخ الأمريكي من الحزبين في رسالة إلى وزير الخارجية مايك بومبيو في مارس / آذار عام 2020، أن الصين تستخدم تقنية التعرف على الوجه لتعريف الأفراد الأويغور، وتصنيفهم على أساس عرقهم، وتخصيصهم للتعقب، وسوء المعاملة، والاحتجاز. 11

يوفر التطور القوي للصين واستخدام التعرف على الوجه، استخدام مغاير وتحريف للتكنولوجيا، فالتقنية التي تساعد على فتح هواتف آيفون على سبيل المثال عن طريق التعرف على الوجه، يتم استخدامها في الصين لتمكين قمع التصرفات التي لا ترتقي إلى مستوى الجريمة. فالمسؤولون الصينيون يستخدمون أدوات المراقبة لفضح الأشخاص الذين يرتدون ملابس النوم في الأماكن العامة، واصفين ذلك بأنه سلوك غير حضاري.

قال خبراء المراقبة إن المعاقبة على هذه الجرائم البسيطة يتم بشكل متعمد. وذلك عبر التهديد بالإذلال العلني من خلال التعرف على الوجه، وتوجيه أكثر من مليار شخص نحو ما يعتبره سلوكًا مقبولًا، من الملابس التي ترتديها إلى طريقة عبور الشارع.

وأوضحت مايا وانغ باحثة أولى في الشؤون الصينية في هيومن رايتس ووتش، إن السلطات الصينية تحاول وضع مراقبة شاملة وهندسة سلوكية على نطاق واسع. بهدف إنشاء نوع من المجتمع يكون من السهل عليهم إدارته.

لدى مؤسسة داربا الحكومية التابعة لوزارة الدفاع الأمريكية خطة لاستثمار ما يصل إلى 2 مليار دولار في أبحاث وتطوير الذكاء الصنعي في السنوات الخمس المقبلة. هذا بالإضافة إلى ملياري دولار أنفقتها الحكومة الفيدرالية بالفعل على البحث والتطوير في مجال التكنولوجيا القائمة على الذكاء الصنعي.

لكن داربا لديها مشكلة. في حين أن غالبية الناس في الولايات المتحدة لديهم موقف متسامح تجاه استخدام التعرف على الوجه في بعض الاستخدامات المدنية مثل المطارات ومتاجر البيع بالتجزئة والأماكن العامة، ولكن الاستخدام العسكري أمر مختلف، فالكثير من الناس يشعرون بالقلق بشأن استخدام التعرف على الوجه والتقنيات الأخرى القائمة على الذكاء الصنعي في السياق العسكري.

هذا الشعور بالقلق ينبع من هدف التقاط الصورة أو الفيديو. على سبيل المثال في مراكز البيع بالتجزئة، تلتقط الكاميرات لتتبع التحويل والمعاملات المالية. لا يهتم تجار التجزئة بالأفراد بشكل خاص، بل يهتمون بسلوكهم الشرائي.

في السياق العسكري، الغرض منه هو التحديد والتصنيف والتحقق، وإذا لزم الأمر تجنب أي تهديد ممكن. قد يبدو هذا تطبيقًا مقبولًا نوعًا ما. وبالرغم من ذلك فإن مصدر القلق الرئيسي في التعرف على الوجه هو دقته.

أجرى المعهد الوطني للمعايير والتكنولوجيا (NIST) اختبار الدقة لخوارزميات مختلفة للتعرف على الوجه وخلص إلى أن 28 خوارزمية تم اختبارها، لديها معدل فشل بنسبة 0.2% فقط. ومع ذلك، تشير أبحاث أخرى إلى أن التكنولوجيا ليست دقيقة بما يكفي لتحديد الأشخاص بشكل صحيح وتظهر بعض التحيز، خاصة للأشخاص ذوي البشرة الداكنة.

مثل هذه الأخطاء، عندما تقترن بالقوة المميتة الآلية، يمكن أن تؤدي إلى أخطاء قاتلة. تطالب الأطراف المعنية بوضع اللوائح والقوانين، لكن الشكل الذي ستتخذه هذه الأنظمة يخضع لنقاش حاد.

هذه المخاوف جعلت موظفي جوجل يتفاعلون بقوة مع Project Maven، وهو عقد مستمر مع وزارة الدفاع لمراقبة الطائرات بدون طيار القائمة على الذكاء الصنعي. مما دفع الشركة حينها إلى اتخاذ قرار بعدم تجديد العقد عند انتهاء صلاحيته في مارس / آذار 2019 الماضي. وذلك بسبب اعتقاد العديد من الموظفين أنه يجب على الشركة تجنب الانخراط في أعمال الحرب.

دفع هذا الاعتقاد أيضًا شركة جوجل للتخلي عن العطاءات الخاصة بمشروع وزارة الدفاع الأكبر، والذي يطلق عليه اسم البنية التحتية المشتركة للدفاع (JEDI) للبنتاغون. بقيمة حوالي 10 مليارات دولار على مدى 10 سنوات، لا يزال عمالقة التكنولوجيا الآخرون مثل أمازون ومايكروسوفت وآي بي إم يتنافسون على العقد المربح لترحيل بيانات البنتاغون إلى التخزين السحابي بالإضافة إلى العقود الأخرى التي تحدد استخدام التعرف على الوجه.

كما ويبحث الجيش أيضًا عن المواهب من الشركات الخاصة الصغيرة والأوساط الأكاديمية لمواجهة تحديات ساحة المعركة القائمة على الذكاء الصنعي وليس فقط ضمن شركات التكنولوجيا الكبرى.

فقد قام الجيش الأمريكي رسميًا بإطلاق فريق عمل الذكاء الصنعي الخاص به في 1 فبراير / شباط في عام 2019، والذي تم تحديده كشبكة من خبراء الذكاء الصنعي في المؤسسات الخاصة والأكاديمية. يقع المقر الرئيسي لفريق العمل في جامعة كارنيجي ميلون.

التعرف على الوجه هو طريقة غير مباشرة للبحث عن الهوية والتحقق منها. يمكن التقاط الصور ومقاطع الفيديو دون التفاعل مع الهدف، مما يجعلها طريقة أمان وفعالة. ومع ذلك فإن تقنية التعرف على الوجه ليس دقيقًا دائمًا.

تعتمد الدقة على قدرة البرنامج على اكتشاف النقاط العقدية للوجه ومطابقتها. تحتاج معظم خوارزميات التعرف على الوجه إلى كميات وفيرة من البيانات لتدريبها، ولديها حساسية للاختلافات بين الصور المخزنة والمستهدفة.

عندما لا تكون البيانات متاحة لتدريب الخوارزمية على التعرف على الأنماط بصورة كافية أو عندما تكون الصورة المستهدفة مشوشة أو مأخوذة في ظل ظروف غير مثالية، فإن هذا يضعف قدرة البرنامج على تحقيق مستوى عالٍ من الدقة.

لمواجهة مشكلة ضعف الدقة، طور قسم الأسلحة بمركز الحرب الجوية البحرية في بحيرة الصين برنامجًا متكيفًا للتعرف على الوجه. يتطلب البرنامج بيانات أقل بكثير لتدريب الخوارزمية ولديه القدرة على دمج واستخدام البيانات الجديدة عند ظهورها. وسيكون بمقدور البرنامج أيضًا تحمل الاختلافات بين الصور المخزنة والمستهدفة مثل الإضاءة والزاوية والمقياس، خاصةً عند تشغيل أكثر من جهاز استشعار.

تتطلب هذه التقنية التكيفية معالجًا إلكترونيًا واحدًا على الأقل مرتبطًا بأداة معالجة التصنيف، وقاعدة بيانات واحدة تحتوي على عدة صور لأهداف معروفة، وصورة اختبار واحدة لهدف غير معروف، ويقوم النظام بإنشاء قاموس للمقارنة بين صورة الاختبار وصور متعددة للأهداف المعروفة.

إن الاستخدام المفيد لهذا النوع من البرامج هو التعرف على الصديق من العدو. يحتفظ الجيش عادة بسجلات متعددة لتحديد هوية أفراده، والتي تتضمن بالتأكيد صورًا. ويمكن للبرنامج التعرف بسرعة على الوجوه غير الموجودة في قاعدة البيانات الخاصة به، ووضع علامة عليها، وتنبيه الموظفين حول وجود أفراد غير مصرح لهم. ويمكن أن يكون هذا أحد أفضل الميزات في ساحة المعركة. وبالإمكان تخصيص البرنامج للتعرف على السفن والبعثات أو الإشارات الخاصة بالحرب الإلكترونية عند الضرورة.

يواجه الجيش مشكلة عندما يتعلق الأمر بالتعرف على الوجوه في الإضاءة الخافتة أو في الليل. إذ يعتمد برنامج التعرف على الوجه القياسي على التفاصيل المرئية في صورة أو مقطع فيديو لإجراء تطابق، وبناء على ذلك لا تحقق بعض الخوارزميات نتائج دقيقة في الإضاءة الخافتة. عندما يكون وجه الهدف في الظل أو غير مرئي على الإطلاق بسبب نقص مصدر الضوء، فإن نقص التفاصيل سيجعل التعرف الدقيق على الوجه أمرًا غير محتمل.

يستخدم الجيش التصوير الحراري للكشف عن الأهداف، وبفضل هذه التقنية من الممكن التعرف على وجوه هذه الأهداف في بعض الأحيان. ورغم ذلك سيظل نظام التعرف على الوجه التقليدي غير قادر على إجراء تطابق دقيق، حيث لن تتوفر التفاصيل المرئية.

ولمعالجة هذه المشكلة، توصل العلماء في مختبر أبحاث الجيش الأمريكي إلى طريقة تستخدم الطيف المرئي وبرامج التعرف على الوجه الحالية لتوليد مساحة مرئية من صورة حرارية. ترسم الصور الحرارية المناطق الساخنة والباردة في الوجه، وهذا كافٍ لتوليد معلومات مهمة لطريقة التركيب الصحيحة.

يوجد أدناه مقطع فيديو مدته 40 ثانية يوضح كيفية عمل الطريقة:

استخدم العلماء الشبكة العصبية الملتفّة “CNN”، وهي نوع من خوارزمية التعلم العميق، لوضع التفاصيل المفقودة من الوجه، مثل العين والأنف والفم. تعمل الشبكة العصبية الملتفّة بشكل مشابه للدماغ البشري حيث يمكنها استقراء صورة من كمية صغيرة من البيانات عن طريق تعيين قيم لجوانب معينة من صورة غير مكتملة. وبالرغم من ذلك قد تكون النتيجة غير واقعية، إلا أن هناك نقاطًا أو معالم رئيسية كافية لبرنامج التعرف على الوجه لإجراء تطابق دقيق في كثير من الحالات.

تم استخدام الطائرات بدون طيار على نطاق واسع من قبل الجيش لأسباب مختلفة. أصبحت هذه الطائرات جزءًا أساسيًا من العمليات العسكرية باختراع طائرة MQ-1 Predator واستخدمت فوق أفغانستان في أواخر عام 2001، وسمحت بالاستطلاع والمراقبة وجمع المعلومات الاستخبارية في المناطق التي يتعذر الوصول إليها أو الخطرة. معظم الطائرات بدون طيار البالغ عددها تقريبًا 8000 الموجودة في مخزون الجيش الأمريكي قادرة على تصوير مقاطع فيديو، ويمكن لبعض أكبرها التقاط صور عالية الدقة.

المشكلة هي معالجة كل هذه الفيديوهات والصور في الوقت المناسب. يستغرق المحللون البشريون وقتًا طويلاً لتصفح مجموعات من مقاطع الفيديو والصور التي التقطتها هذه الطائرات.

ولزيادة كفاءة التحليل، لجأ الجيش إلى تقنية الذكاء الصنعي لمواجهة هذا التحدي. لقد تعاقدت على وجه التحديد مع جوجل لبناء برنامج ذكاء اصطناعي باستخدام أنظمة الذكاء الصنعي TensorFlow كجزء من فريق الخوارزميات متعدد الوظائف أو ما يدعى Project Maven.

يتضمن العقد العسكري استخدام برنامج الذكاء الصنعي لتحليل اللقطات واكتشاف التهديدات وتخصيص الأشياء المهمة لمراجعتها من قبل المحللين البشريين، والتي ستكون بعد ذلك الأساس لاتخاذ القرارات العسكرية. تدعي وزارة الدفاع أن المعلومات المستمدة من التحليل بمساعدة التعلم الآلي يمكن أن تساعد في تقليل الأضرار الجانبية وتخفيف التهديدات والحفاظ على سلامة الجنود على الأرض.

وفي أحدث حالات استخدام لتقنية التعرف على الوجه، أعلن هوان تون-ذات، الرئيس التنفيذي لشركة قبل Clearview AI قبل يومين، إن وزارة الدفاع الأوكرانية بدأت يوم السبت في استخدام تقنية التعرف على الوجه من Clearview AI، بعد أن عرضت الشركة الأمريكية الناشئة الكشف عن المهاجمين الروس ومكافحة التضليل وتحديد هوية القتلى.

وأضاف الدبلوماسي السابق ومستشار Clearview AI لي وولوسكي، أن أوكرانيا تتلقى الآن حرية الوصول إلى محرك البحث القوي للوجوه من Clearview AI، مما يسمح للسلطات بفحص الأشخاص المعنيين عند نقاط التفتيش، والعديد من الاستخدامات أخرى.

وبدأت الخطط تتشكل بعد العملية العسكرية الروسية في أوكرانيا، حيث أرسل الرئيس التنفيذي لشركة Clearview AI هوان تون-ذات رسالة إلى كييف يعرض فيها المساعدة، فيما لم تُعرض التكنولوجيا على روسيا، التي تصف أعمالها في أوكرانيا بأنها “عملية خاصة”.

وأشار مؤسس Clearview AI إن شركته الناشئة لديها أكثر من ملياري صورة تحت تصرفها من خدمة التواصل الاجتماعي الروسية فكونتاكتي، من أصل قاعدة بيانات تضم أكثر من 10 مليارات صورة.

وأضاف تون أن قاعدة البيانات هذه يمكن أن تساعد أوكرانيا في التعرف على القتلى بسهولة أكبر من محاولة مطابقة بصمات الأصابع وتعمل حتى لو كان هناك تلف في الوجه. كما ستعمل هذه التقنية للم شمل اللاجئون المنفصلين عن عائلاتهم، وتحديد العملاء الروس ومساعدة الحكومة على فضح المنشورات الزائفة على وسائل التواصل الاجتماعي المتعلقة بالحرب. ولكن لا ينبغي استخدام Clearview أبدًا كمصدر وحيد لتحديد الهوية وأنه لا يريد استخدام التكنولوجيا في انتهاك لاتفاقيات جنيف، التي وضعت معايير قانونية للمعاملة الإنسانية أثناء الحرب.

قد تكون الخصوصية هي إحدى أكبر المخاوف عندما يتعلق الأمر بتقنية التعرف على الوجه. تمنح أنظمة التعرف على الوجه الوكالات الحكومية القدرة على مراقبة أنشطتنا في الأماكن العامة. ويمكن من أجل تحقيق القانون استخدام هذه التقنية لتحديد أي شخص وتعقبه، حتى لو لم يفعل أي شيء مريب. هذا يعتبر انتهاك للحريات الدستورية في التعبير من منظور الكثير من الجمعيات الحقوقية حول العالم.

تقنية التعرف على الوجه عرضة لسوء الاستخدام. على سبيل المثال، يمكن استخدام تقنية تحليل الوجه لاستهداف الأشخاص المشاركين في المظاهرات المناوئة للحكومات.

أنظمة التعرف على الوجوه ليست دقيقة للغاية عندما يتعلق الأمر بتحديد وجوه الأقليات العرقية.

أظهرت دراسات متعددة أن برامج التعرف على الوجه غالبًا ما تخطئ في التعرف على الأشخاص ذوي البشرة السمراء (خاصة النساء السمراوات). بسبب ممارسات الشرطة المتحيزة عنصريًا، تحتوي قواعد البيانات الجنائية على عدد غير متناسب من الأمريكيين ذو الأصول الأفريقية والأقليات العرقية الأخرى.

كما نلاحظ أن الأشخاص الذين يعارضون تقنية التعرف على الوجه لديهم سبب وجيه، وذلك بسبب تفوق عيوب تقنية التعرف على الوجه على فوائدها إلى حد كبير، ولا توجد تشريعات كافية حول استخدامها لضمان حماية واحترام خصوصية الأشخاص.

هل أعجبك المحتوى وتريد المزيد منه يصل إلى صندوق بريدك الإلكتروني بشكلٍ دوري؟

انضم إلى قائمة من يقدّرون محتوى إكسڤار واشترك بنشرتنا البريدية.